「LLM(大規模言語モデル)とは何か」の原稿作成(by Copilot)

💬 Copilotと相談して原稿作成する様子

|

ユーザー:

※ LLM の仕組みについて詳しく知りたい方は、末尾の参考情報のYouTube動画をご覧ください。これから新しい話をします。 それは、LLM (大規模言語モデル)とは何かを、ごく簡単に、「さとうささら」さんに説明してもらうための相談です。 説明のために、図を1つ用意しました。説明の目的は、その図だけを使って、LLM を知らない人にも、およそのイメージをもってもらうことです。 「さとうささら」のキャラクター定義は、次のページにあります。 https://cevio.jp/cevio_character/ まず、その図がどんなものかを(私が Copilot に)後述しますので、一旦それだけの情報から、「さとうささら」さんが行うと想定した説明の原稿を作ってほしいです。 以下、LLM説明図について記述します。 |

|

|

ユーザー:

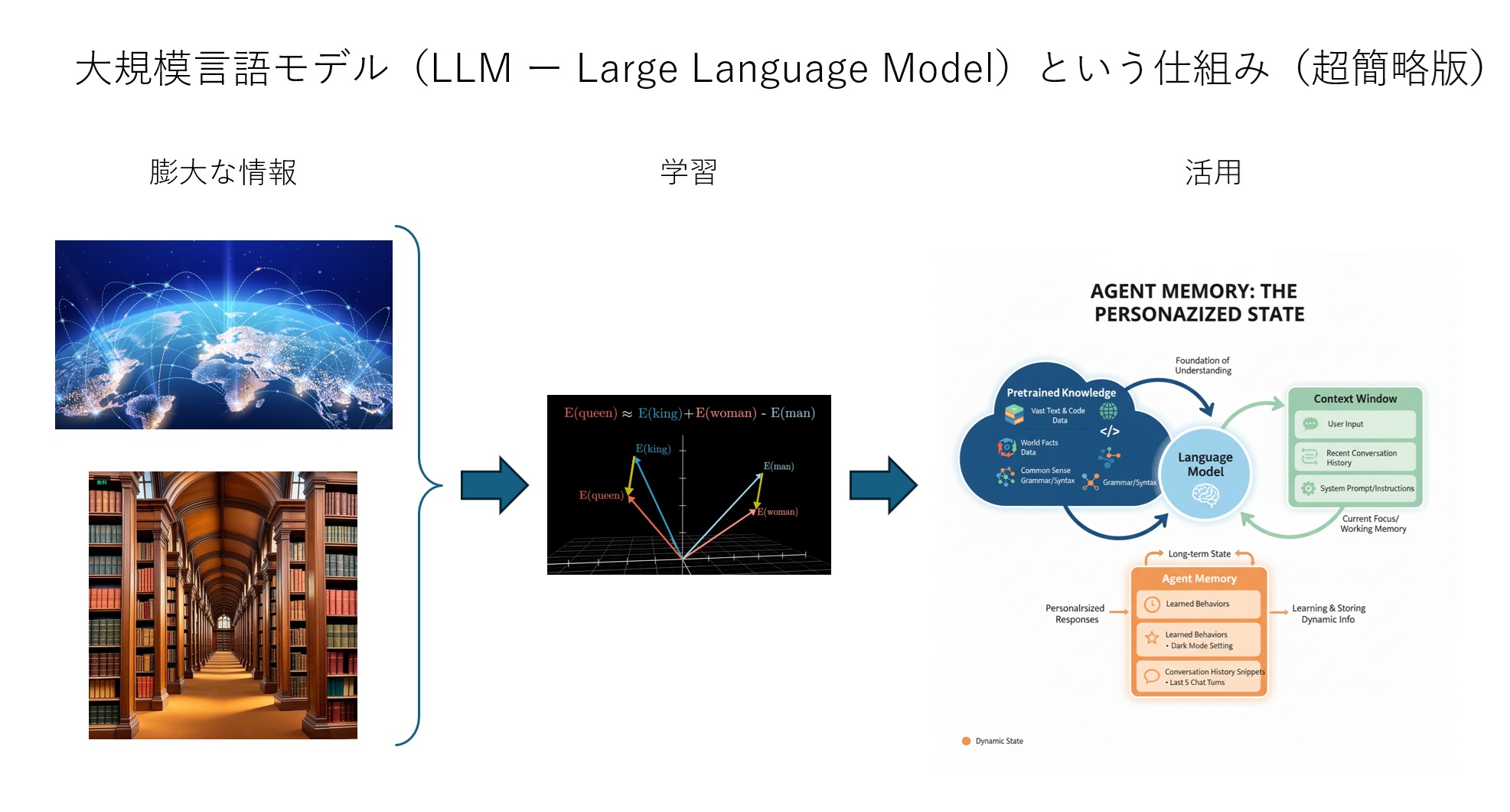

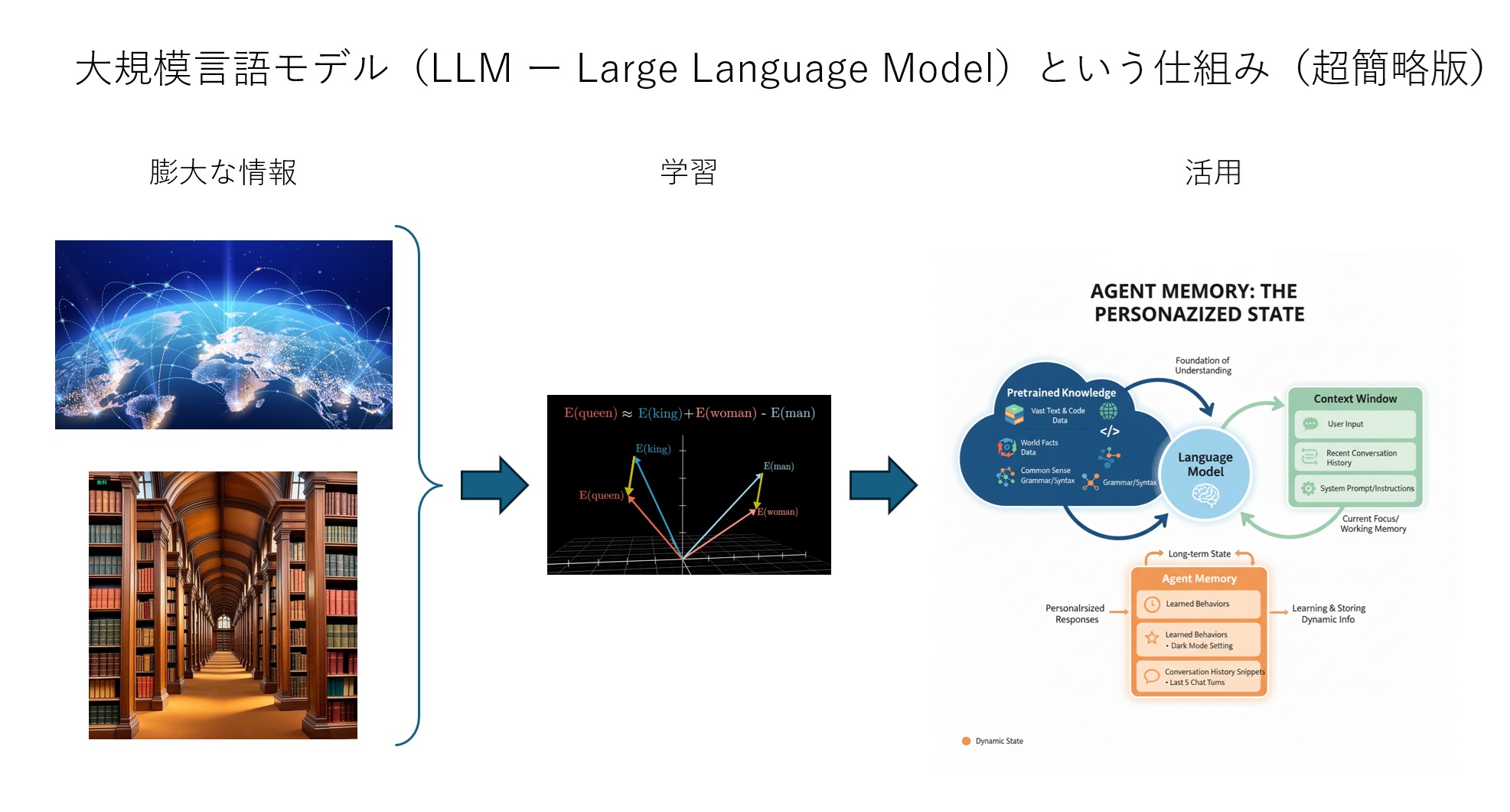

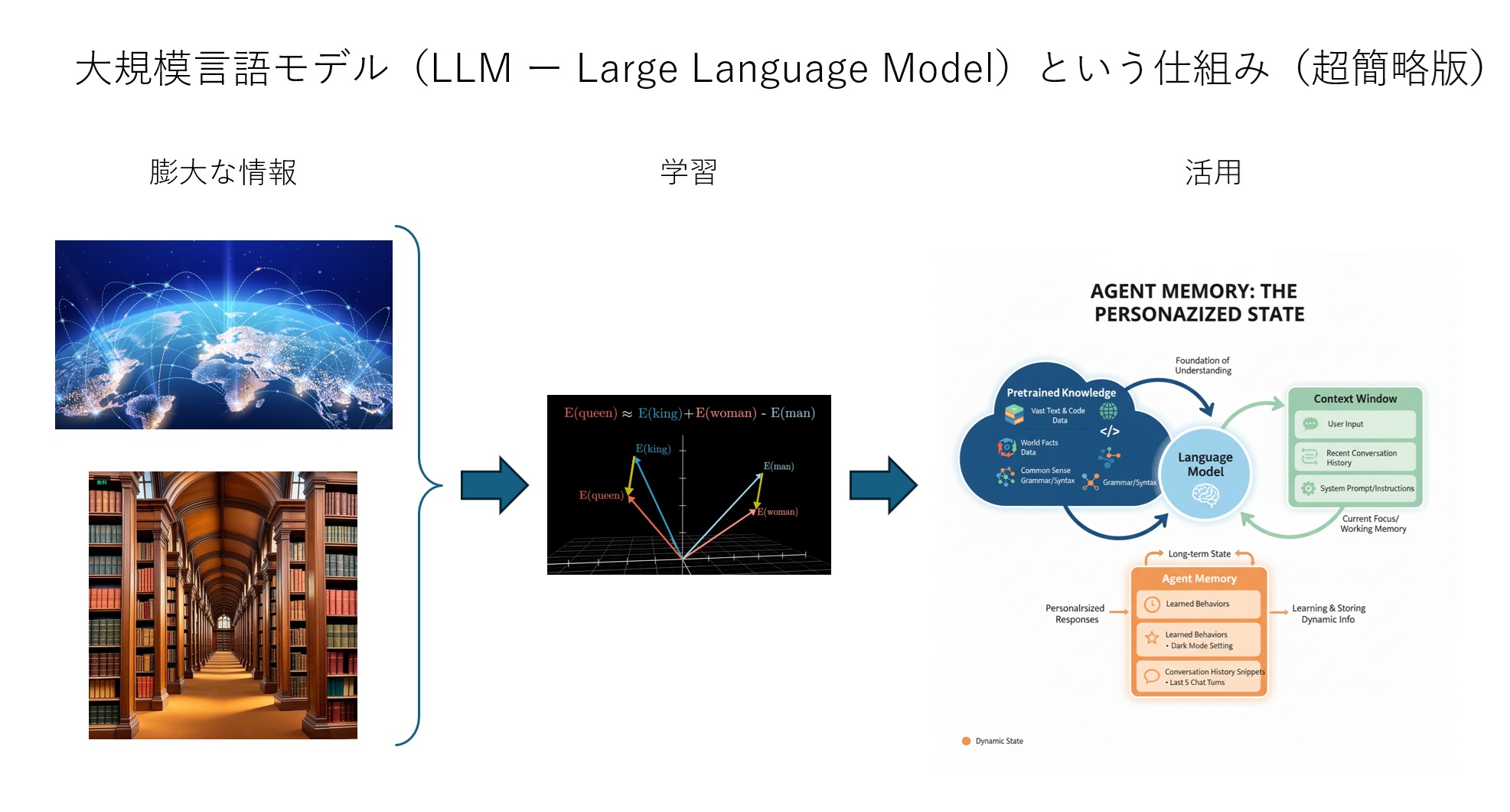

※ LLM の仕組みについて詳しく知りたい方は、末尾の参考情報のYouTube動画をご覧ください。図のタイトルは、「大規模言語モデル(LLM ー Large Language Model)という仕組み(超簡略版)」です。 図は、左、中央、右の3つの部分からなり、左から順に「膨大な情報」→「学習」→「活用」というサブタイトルがついています。 左の部分は、タイトルの下に、インターネットと図書館を連想させる画像が縦に並んでいます。 中央の部分は、学習の様子を3次元空間上に位置付けさられた単語の関係をベクトルを示す矢印で表現したもので、 Man → Woman と King → Queen の関係が示されています。 右の部分は、LLM が3つの記憶(Pretrained Knowlegde, Agent Memory, Context Window)を使って働く様子を示しています。 とりあえず、以上の情報で、簡単な原稿を作ってほしいのですが、可能でしょうか? |

|

|

Copilot:

はい、可能です。 ご要望に沿って、「さとうささら」さんがLLM(大規模言語モデル)を図だけでやさしく説明する原稿案を作成します。 こんにちは、さとうささらです! 今日は「大規模言語モデル(LLM)」について、図を使ってとっても簡単にご説明します。 この図は、左・中央・右の3つの部分に分かれています。 まず左側、「膨大な情報」と書かれたところには、インターネットや図書館のイメージがあります。 これは、LLMがたくさんの本やウェブの情報を材料にしていることを表しています。 次に中央の「学習」では、言葉同士の関係を学んでいる様子が描かれています。 たとえば、「Man(男)」から「Woman(女)」への関係と、「King(王)」から「Queen(女王)」への関係が、矢印でつながっています。 LLMは、こうした言葉のつながりや意味の違いを、たくさん学んでいるんです。 最後に右側の「活用」では、LLMが3つの記憶(知識・エージェントの記憶・会話の流れ)を使って、質問に答えたり、会話したりしている様子が描かれています。 このように、LLMはたくさんの情報を学んで、言葉の意味や関係を理解し、いろいろな場面で活用されているんですよ! ご希望に合わせて、さらにやさしくしたり、キャラクターらしい表現に調整も可能です。 |

|

|

ユーザー:

骨格は、これでいいのですが、Copilot がもっている Pretrained Knowlegde を使って、もう少し詳しく、かつ、分かりやすい内容に変更できますか?

Copilot:

もちろん可能です。Copilot(GPT-4.1)が持つPretrained Knowledgeを活かし、図の内容に沿って、もう少し詳しく・分かりやすく、かつ「さとうささら」さんらしい親しみやすい語り口で原稿をアップデートします。 こんにちは、さとうささらです! 今日は「大規模言語モデル(LLM)」について、図を使って分かりやすくご紹介します。 この図は、左・中央・右の3つの部分に分かれています。 【左:膨大な情報】 まず左側には、インターネットや図書館のイメージがあります。 これは、LLMが本やウェブサイト、百科事典など、世界中のたくさんの文章や知識を材料にしていることを表しています。 こうした膨大な情報をもとに、LLMは「言葉の使い方」や「知識」をたっぷり学びます。 【中央:学習】 真ん中の部分では、LLMが言葉同士の関係を学んでいる様子が描かれています。 たとえば、「Man(男)」から「Woman(女)」への関係と、「King(王)」から「Queen(女王)」への関係が、矢印でつながっています。 これは、LLMが「似たような関係性」や「言葉の意味の違い」を、たくさんの例から見つけて覚えていることを表しています。 この学習は、コンピュータの中の“頭の中”で、言葉を数字やベクトル(矢印)で表して行われます。 【右:活用】 右側では、LLMが実際に活躍している様子が描かれています。 LLMは「Pretrained Knowledge(事前に学んだ知識)」をベースに、「Agent Memory(会話の履歴やユーザーとのやりとりの記憶)」、そして「Context Window(今の会話や質問の流れ)」という3つの“記憶”を使って、質問に答えたり、会話を続けたりします。 たとえば、みなさんが「ささらさん、AIって何?」と聞いたとき、LLMはこれらの記憶を組み合わせて、分かりやすい答えを考えてくれるんです。 このように、LLMはたくさんの情報を学び、言葉の意味や関係を理解し、みなさんの質問や会話に役立てているんですよ! さらにやさしい表現や、キャラクターらしいアレンジもご希望に応じて調整できます。 |

|